ฟีเจอร์ใหม่นี้อาจไม่ได้ว้าวน่าตื่นเต้นจนเปลี่ยนโลกได้ แต่มันก็เปลี่ยนการคุย FaceTime ไปเลย เปลี่ยนให้เราได้สบตากับคู่สนทนา เพิ่มความรู้สึกว่าได้คุยกันอย่างตั้งใจและใส่ใจกันอย่างดี โดยฟีเจอร์ใหม่ใน iOS 13 Beta นี้คือการปรับให้ดวงตาของเรามองกล้องโดยอัตโนมัติเมื่อคุย FaceTime

ปกติเวลาคนเราคุย FaceTime ก็มักจะมองที่หน้าจอเป็นหลัก เพราะเรามองหน้าคู่สนทนาที่อยู่ตรงหน้าจอ มองว่าอีกฝ่ายทำอะไรอยู่ ไม่ได้มองตรงไปยังกล้องที่อยู่มุมบนของตัวเครื่อง ดังนั้นภาพที่อีกฝ่ายเห็นก็คือเรามองที่จอ มองตรง ๆ ไม่ได้มองสบตาพวกเขา

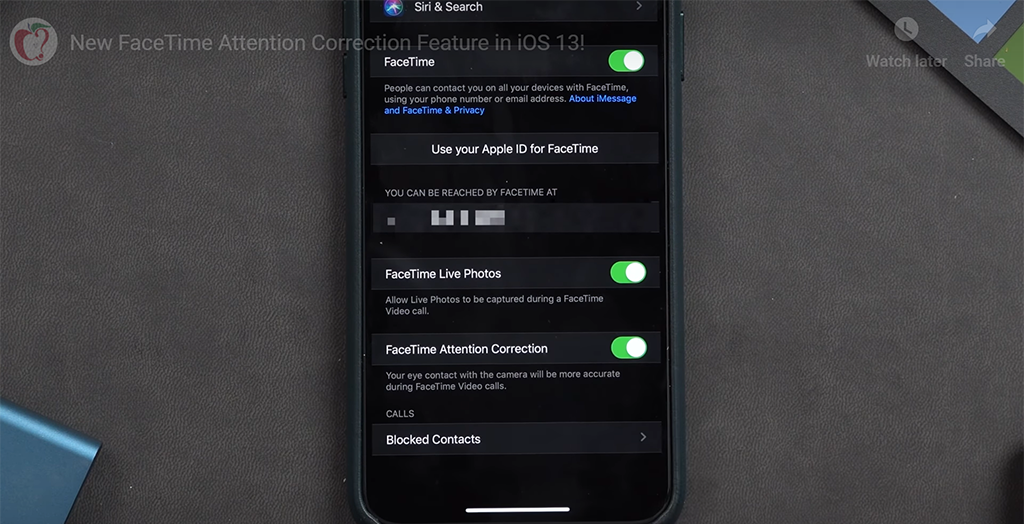

ปัญหานี้จะหมดไป เมื่อ iOS 13 เพิ่มฟีเจอร์ “FaceTime Attention Correction” ซึ่งจะแก้ไขให้ดวงตามองตรงไปยังกล้อง มองคู่สนทนา ได้สบตาพวกเขา ไม่ใช่จ้องที่หน้าจอแบบเดิม

How iOS 13 FaceTime Attention Correction works: it simply uses ARKit to grab a depth map/position of your face, and adjusts the eyes accordingly.

Notice the warping of the line across both the eyes and nose. pic.twitter.com/U7PMa4oNGN

— Dave Schukin 🤘 (@schukin) July 3, 2019

ระบบไม่ได้บังคับให้ต้องมองที่กล้องจริง ๆ หรอกค่ะ แต่เป็นการเปลี่ยนภาพดวงตาของเราด้วยระบบ ARKit ทำให้คู่สนทนาเห็นว่าเรามองกล้อง มองตรงไปที่พวกเขาอยู่ ทั้งที่จริง ๆ เราก็ยังมองที่หน้าจออยู่เหมือนเดิม โดย ARKit จะสแกนหน้าและดวงตาเรา ประมวลผล แล้วสร้างภาพซ้อนทับให้เห็นว่าดวงตาเราจ้องมองไปยังกล้อง

ทั้งนี้ ARKit คือเทคโนโลยี AR ที่ Apple พัฒนาขึ้น ซึ่ง AR คือการผสมผสานระหว่างภาพความเป็นจริงและภาพจากโลกเสมือนที่สร้างขึ้น หรือพูดง่าย ๆ ก็คือเอาภาพจริงและภาพที่สร้างขึ้นด้วยโปรแกรมคอมพิวเตอร์มารวมกัน ถ้ายังนึกไม่ออกก็ให้นึกถึงเกม Pokémon GO ที่เราต้องเปิดกล้องเพื่อใช้ถ่ายภาพพื้นที่จริงที่อยู่ตอนนั้น จากนั้นจะมีภาพมอสเตอร์ซึ่งเป็นภาพที่สร้างขึ้นจากคอมพิวเตอร์แสดงขึ้นมา แล้วจากนั้น AR ก็จะนำภาพทั้งสองอย่างมารวมกันเป็นเกมให้เราได้เล่นสนุกกัน

แต่ยังไม่มีการยืนยันจาก Apple ว่าฟีเจอร์นี้จะใช้ได้กับ iPhone และ iPad ทุกรุ่นหรือไม่ เพราะตอนนี้ยังใช้ได้เฉพาะ iPhone XS, iPhone XS Max, iPhone XR, และ iPad Pro ปี 2018 เท่านั้น

ที่มา macrumors.com (1), macrumors.com (2), Dave Schukin และ Will Sigmon